La norme Rec 709 décrit l’espace colorimétrique utilisé dans la création et la diffusion de contenus HD. Elle est utilisée dans l’industrie de la télévision, du cinéma et de l’audiovisuelle car elle garantit que tous les équipements affichent la même image. Bien que cela soit associé à la résolution SD et HD, elle reste l’espace colorimétrique le plus courant pour offrir des résolutions plus élevées, telles que la 4K UHD ou 8K, pour le contenu vidéo domestique (Netflix, NHK).

Le Rec 709 en détail

Introduit pour la première fois en 1990, le Rec 709 permet de définir les couleurs standards de l’industrie audiovisuelle.

L’acquisition initiale est possible en entrelacé et progressif.

- On peut enregistrer la vidéo en progressif par le capteur et la transmettre en images progressives ou images PSF (Progressive segmented Frame).

- L’acquisition en entrelacé peut être transmise en entrelacé. Dans le cas où on transmet une image progressive en PsF, on doit adapter la fréquence trame pour qu’elle soit le double de la fréquence image.

Ce format définit les spécifications d’une image finale pour l’utilisation en télévision professionnelle et grand public. Pour le 4K, on utilisera bientôt la norme REC2020 et REC 2100 et pour le cinéma la norme DCI D-Cinema – DCI P3.

Comprendre ces espaces colorimétriques permet de bien régler votre caméra. Cela nous permet à son tour une utilisation optimale du signal vidéo suivant les besoins d’une production. En effet, on ne travaillera pas de la même façon pour un reportage télévisuel ou un documentaire. Dans beaucoup de situations, un réglage standard peut vous apporter satisfaction. Mais dans le cadre du cinéma, ou en téléfilm, les réalisateurs désirent avoir une plus grande latitude à l’étalonnage. De cette façon ils peuvent changer l’atmosphère d’un plan et ainsi plonger le téléspectateur dans une autre dimension. C’est là qu’interviennent les autres modes LOG ou RAW. (voir nos articles)

Le traitement d’une image finale en REC709 dans les caméras ou DSLRs est équivalent aux images JPEG pour la photo. Au final, on obtient une image finie qui doit correspondre le plus possible à la réalité du terrain filmé.

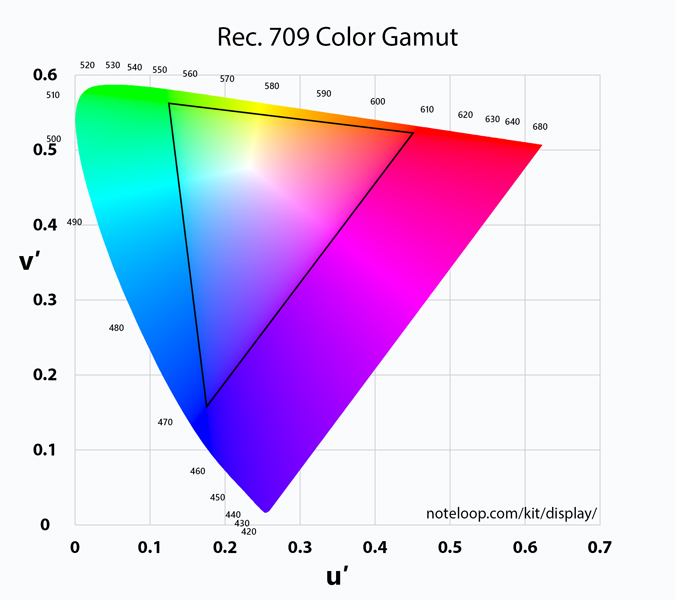

L’espace colorimétrique des images

Pour comprendre un peu mieux l’environnement vidéo, voici quelques rudimentaires sur le signal vidéo. Tout le monde a entendu parler des modes RVB ou CMJN. On utilise ces espaces en photographie pour un affichage sur écran informatique pour le mode RVB et en imprimerie pour le CMJN. En vidéo, la norme de diffusion REC709 permet d’établir une relation directe entre ces deux espaces colorimétriques.

On adapte les signaux des caméras pour correspondre au mieux au triangle de cet espace colorimétrique. Ainsi on respecte les normes de diffusion télévisuelle.

On parle aussi de GAMUT qui représente l’étendue de l’espace colorimétrique limitée par les 3 points du triangle désignés par les coordonnés max en saturation de rouge, vert et bleu.

Avec l’apparition de la 4K, les constructeurs ont mis au point une nouvelle norme élargissant considérablement ce spectre, le REC2020. Dans la pratique

- les images diffusées sur les écrans sont plus près de la réalité

- et les images en DCI (cinéma) sont mieux reproduites pour un plaisir accru pour les téléspectateurs.

Les formats RAW en vidéo

Pour obtenir une plus grande latitude de travail en vidéo, on peut tourner avec des fichiers RAW (brut en anglais). Cela permet de garder le maximum d’informations dans les hautes et basses lumières et garantir un étalonnage précis en post-production. Ces réglages pilotent le laboratoire numérique intégré à nos caméras modernes. Ainsi nous pouvons passer du “négatif” numérique (le fichier brut ou RAW) au “positif” numérique (JPEG). En vidéo, on a l’habitude d’appeler le RAW le “négatif” numérique, par opposition au “positif” numérique très compressé. Celui là est destiné à la diffusion audiovisuelle.

Pour réaliser une image prête à la diffusion dès la fin du tournage, nous utilisons un JPEG ou le “positif” compressé. Cela réduit aussi considérablement les possibilités de modification et de traitement ultérieurs de l’image. Certes, on va perdre de manière drastique les informations recueillies par le capteur. Mais de l’autre côté, on pourra aboutir à leur plus faible poids numérique.

La post-production

Une image RAW contient toutes les informations enregistrées au niveau du capteur de l’appareil. Et par la suite, il nous faudra développer le RAW pour obtenir l’image finale grâce aux logiciels de montage. (Notion de débayerisation).

Mais depuis que le RAW a envahi nos caméscopes et nos APN (appareils photo numériques), il est possible de ne choisir aucun de ces réglages définitifs. Nous pouvons reporter nos choix artistiques à plus tard, lors d’une deuxième étape appelée post-production en vidéo.

C’est à ce moment qu’il faudra choisir et adapter à chaque scène le bon contraste et la bonne colorimétrie, pour l’intention artistique finale voulue et le support cible. Les photographes vont alors “révéler” numériquement leurs photos RAW, tandis que les vidéastes vont “étalonner” leurs « rush » vidéo, à l’aide de logiciels dédiés à l’étalonnage vidéo tels que DaVinci Resolve. Il est aussi possible de le faire dans les logiciels de montage comme Premiere Pro, Avid Media Composer ou Final Cut Pro X…